Evaluation of Kucas-Kanade alogrithm for Similarity Warps

Introduction

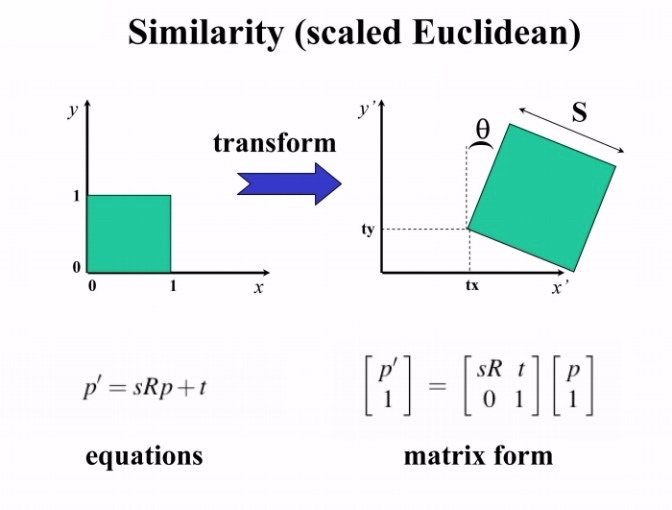

本实验基于开源程序image-align1,目的是为了比较传统的Translational Warping Model和Similarity Warping Model在KLT中的差别。相对于Translational Warping Model只有2维的平移自由度,Similarity Warping Model增加了1维的尺度自动度和1维的旋转自由度。由于自由度的增加,在理论上能够跟踪形变更大的模版图像。

Experimental Design

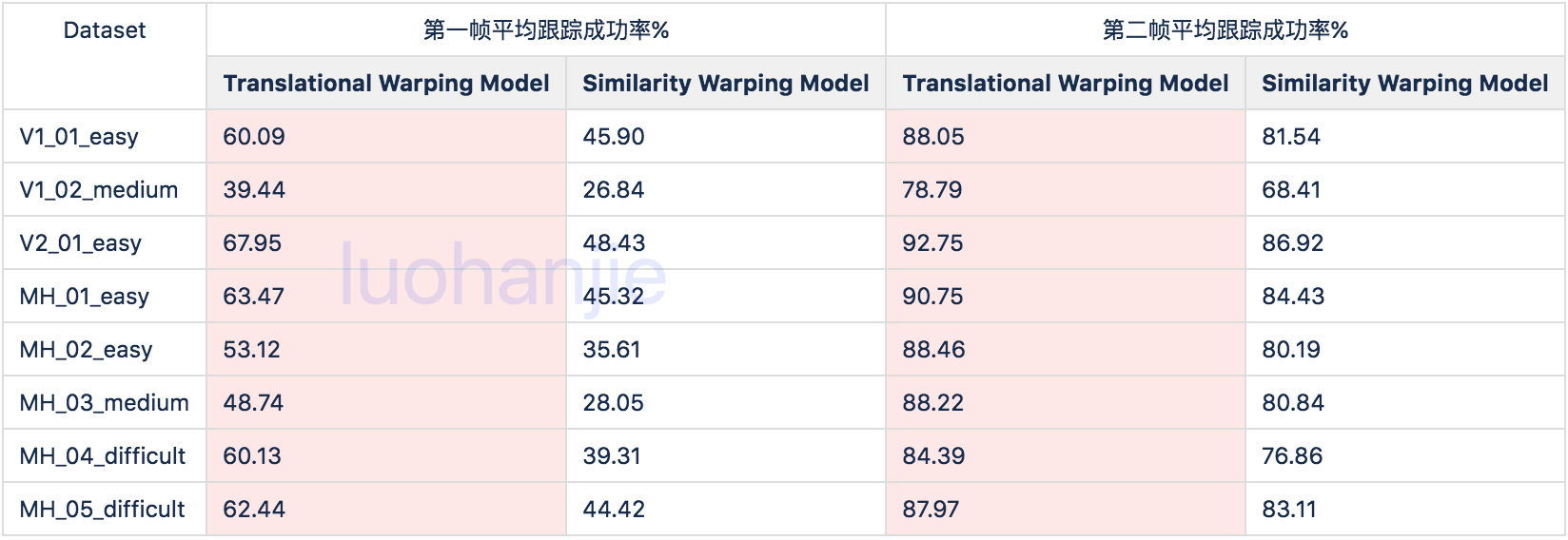

在本实验中,我们主要在The EuRoC MAV Dataset [1]数据集上测试Similarity Warping Model和Translational Warping Model 在KLT上的差别。

测试程序流程如下:

1 | bool is_KeyFrame = false; |

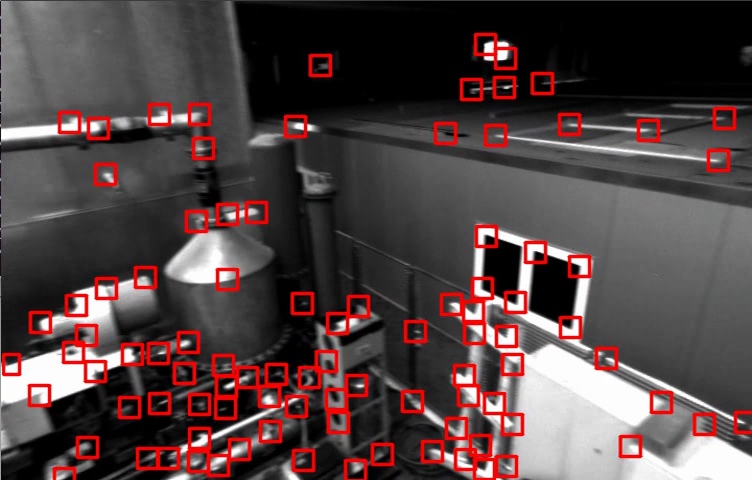

关键帧

会使用Shi-Tomasi角点检测算子算法获取关键点。图中红色框中央为关键点位置,红框范围图像会作为Template输入到KLT中。

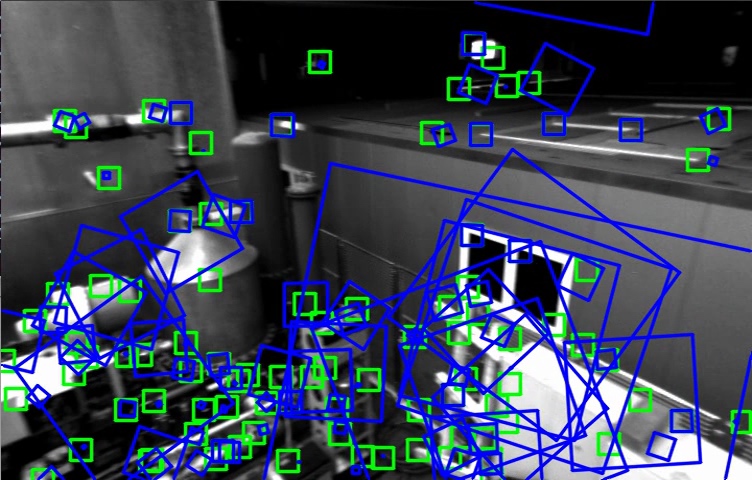

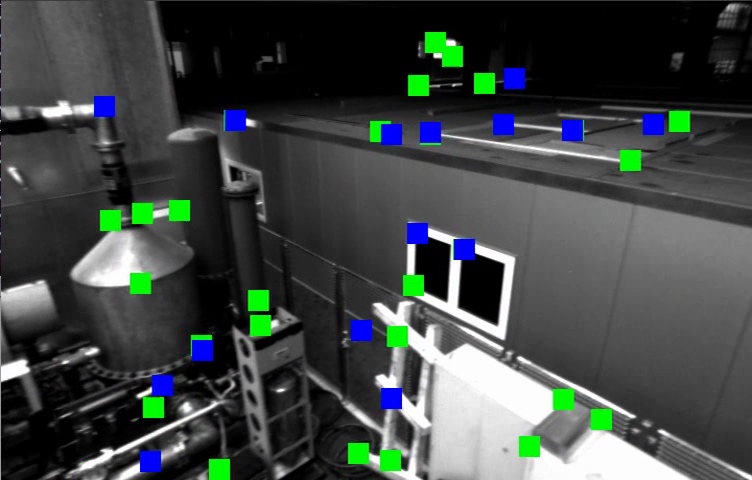

KLT跟踪

绿色方块:Translation Warping Tracking Window 蓝色方块:Similarity Warping Tracking Window

KLT跟踪判定

匹配误差值 小于500时认为跟踪成功。实心矩形表示跟踪成功的点,并且会将此时的位置作为下一帧KLT跟踪的起始位置。

Results

Experiment Videos

MH_05_difficult:

V1_01_easy:

从上表可以看出,第二帧平均跟踪成功率要比第一帧平均跟踪成功率比要高很多,主要因为经过第一帧的跟踪后,留下的都是些比较好跟踪点,所以,第一帧平均跟踪成功率更能体现Similarity Warping Model和Translational Warping Model的区别。在测试的8个测试集中,Translational Warping Model均有着更好的表现。

Conclusion

相比Translational Warping Model的2个自由度,Similarity Warping Model增加了2个自由度(尺度,旋转)达到了4个自由度。在本实验中,Warping Model的初始值是由上一帧的结果决定的,并没有提供额外的约束。所以,随着自由度的增加,Similarity Warping Model往往不能收敛于正确值。虽然就数学来说,Similarity Warping Model(甚至是Affine Warping Model)能提供更好的KLT匹配描述,但为了增加成功率,减少计算量,一方面需要通过其他方法提供一些用于迭代求解时的约束23,另一方面,可以通过提供合适的搜索窗口来限制搜索范围4。

https://github.com/cheind/image-align↩︎

Hwangbo M, Kim J S, Kanade T. Inertial-aided KLT feature tracking for a moving camera[C]//Intelligent Robots and Systems, 2009. IROS 2009. IEEE/RSJ International Conference on. IEEE, 2009: 1909-1916.↩︎

Hwangbo, M., Kim, J.S. and Kanade, T., 2011. Gyro-aided feature tracking for a moving camera: fusion, auto-calibration and GPU implementation. The International Journal of Robotics Research, 30(14), pp.1755-1774.↩︎

Chermak, L., Aouf, N. and Richardson, M.A., 2017. Scale robust IMU-assisted KLT for stereo visual odometry solution. Robotica, 35(9), pp.1864-1887.↩︎